冒頭画像:Global Fact10(ソウル)で話す元ツイッターのヨエル・ロス(右):筆者撮影

(文中敬称略/「Global Fact10報告」はYahoo!ニュースエキスパートでの初出が2023年7月〜8月にかけてであるため、紹介されている投稿の消滅やサービス名の変更が生じております。)

10年目で初のアジア開催

世界各地からミスインフォメーション、ディスインフォメーションと戦うファクトチェッカーが集まる「Global Fact10(グローバルファクト・テン、以下『GF10』と表記)」という会議が、2023年6月27日(火)から30日(金)まで、ソウルで開かれました。

2014年に、ロンドンスクール・オブ・エコノミクスの一教室に数十人のジャーナリズム関係者が集まり、スタートしてから10年目、初めてアジアで開催されたことは意味のあることだと思います。この分野で世界をリードしてきたのは圧倒的に西側の先進国でした。アフリカや南米では、国境を超えた連携などが進む一方、アジアでは異なる言語や政治体制の違いなどのため、なかなか連携が進まず、存在感が薄かったからです。

グローバルファクトの会議を主催してきたIFCN(国際ファクトチェック・ネットワーク)によると今回は、オンラインも含め70カ国以上の国から約500人のファクトチェッカー、ミスインフォメーション対策についての研究者、メディアリテラシーの専門家らが参加したということです。

3日間にわたる多くのセッションの中から、目立った論点や取り組みを紹介していきます。それぞれテーマや問題の当事者や専門家に焦点を当てて解説します。

1回目は前後半に分けて、メインのゲストのひとりとして登場した、ツイッターの元「信頼と安全チーム」の責任者、ヨエル・ロスの発言を通して考えます。前半はツイッターをイーロン・マスクが買収したことの影響や社会的な意味について考えます。

最終日の「大トリ」に登場

ロスがメイン会場に登壇したのは、3日目の6月30日(金)の最後のセッションでした。2022年春から始まったマスクのツイッター買収の動きと、11月の社員の大量解雇という混乱の中で、同時期にあったアメリカの中間選挙、ブラジルの総選挙などを気にかけ、レイシズムやヘイトスピーチの拡散にツイッターが加担しないよう、マスクとの接点を模索しながらも、約2週間後に職を辞した人物です。

マスクが自らツイッター社に乗り込んできて、大量の人員整理などを矢継ぎ早に行った当時のことを「竜巻(whirlwind)」と表現、社員全員が「今、自分の上司は誰なのか、まだ上司がいるようなポジションにいるのか、あるいは自分はまだ会社に席があるのか、まったくわからないままに、2週間くらいが経過した」と、当時の混乱ぶりを語りました。

ニュース的、あるいはもう少し「ゲスな」関心から言うと、マスク氏が会社に乗り込んで来て大量の人員整理を行ったことで、社内にどのような混乱が拡がったのか、実際に会ったマスクとロスが、どんなやりとりをしたのか、などが気になるところです。

しかし司会を務めた、アメリカのファクトチェック・メディア「ポリティファクト」の理事長で実績ある政治ファクトチェッカーでもあるアーロン・シャーロックマンが主にフォーカスしたのは以下の2つの点でした。

1)マスクの社内変革によって、ツイッターの「コンテンツ・モデレーション」機能はどう変わったのか。

(コンテンツ・モデレーションについてはこの文章の後半で説明しています。)

2)2021年1月のアメリカ連邦議事堂乱入事件を引き起こしたとしてトランプ前大統領のツイッターアカウントを停止した判断のプロセス。どのような議論をしたのか。

解体された「信頼と安全チーム」

マスクが同社に乗り込んで人員整理などを始め、混乱が深まる中、ロスはマスクと直接話す機会があり、当初はミス/ディスインフォメーションに対する理解やツイッターの信頼や安全についても、共通の基盤があるのではないかと期待したということです。

ブラジル大統領選の決選投票の混乱を心配していたロスに対し、マスクは理解を示し、「ツイッターがブラジルで暴力の原因になってはいけない」と即座に発言したということです。

しかし、結局彼も、そのやりとりの13日後に職を辞すこととなりました。彼が率いていた「信頼と安全チーム」は、本社に約200人、世界各地に最前線で判断を下していた、合わせて約1000人がいましたが、彼らも次々と辞めていきました。あの時には誰が辞め、誰が残っているのか全くわからないような混乱ぶりだったようです。

そして現在、彼が知る限りでは、当時の「信頼と安全チーム」のメンバーで本社に残っているのは、ただ1人、ツイッターの信頼と安全に関するサービスは「存在していない」と語りました。

「発生もののニュースを知らせる」という価値観

ロスは、2015年に創業者のジャック・ドーシーが経営トップに復帰した後に、ツイッターが目指していたのは、「祖父母に家族のことを報告するようなメディア」から「ブレーキングニュースを知らせるメディア」に変わっていくことだったと言います。

ドーシーが当時、真っ先に取り組んだのは、スマホのアプリストアで、ツイッターのカテゴリーを「ソーシャル・ネットワーキング」から「ニュース」に移行することだったということです。そして、現在、マスクが経営するツイッターが使用を制限しているAPI(Application Programming Interface)をユーザーが自由に活用させて、ニュースを理解したい人を支援することだったと言います。

ロスは、マスクが経営権を掌握してから「その価値観が急速に侵食されてしまった」と述べ、6月下旬にウクライナ戦争をめぐって起きた、いわゆる「プリゴジンの乱」のような現在進行形のニュースイベントが、ツイッター上で十分に伝えられなかったと嘆きました。

「トランプのおかげで稼いでいた」わけではないが・・

アメリカのトランプ前大統領は、2017年からの4年間の任期中、少なくとも3万件を超えるウソ、誇張、強引な決めつけ、ミスリーディングなコメントなどがあったと、ワシントンポストが数え上げています。

彼は公式な発言の前にツイッターに連投するような事例も多かったため、ツイッターが彼のアカウントを停止する対応は遅すぎたのではないか、という批判もありました。

一部には、トランプのポスト(投稿)は、インプレッション(そのツイートが表示された回数=広告が表示された回数)を稼ぐので、モデレート(注意を付記するなどの措置)を避けていたのだとの憶測も呼んでいました。しかし、ロスは「私の経験ではそういうことではない」と否定しました。

しかし、ツイッターが、あの4年間に、社会の被害を軽減することと、ツイートというコンテンツを守るという原則の間でジレンマに悩み、思考停止の状態であったことは認めました。

同社が理想としていた「ニュースや社会的な出来事が起きている場を提供すること」と、「大きな社会的な害悪をもたらす可能性がある公的な人物の発言にアクセスを許すかどうか」という、相反した原則の板挟みで何ら効果的な判断が下せなかったと語りました。

ツイッターは問題のあるツイートに注意を喚起するメッセージを表示するサービスを導入し、発信者が訂正や説明を行うことを促すような対応も取りました。最悪の場合はツイートを削除する対応も可能でした。

しかし、ロスは「2018〜19年の間は、我々はとにかく削除をしたら、その後の対応がどうなるかわからず、恐れていた」と述べ、トランプ本人や支持者、他の陰謀論者などの反応をはかりかねていたことを、うかがわせました。

気持ちよい「場」のための条件

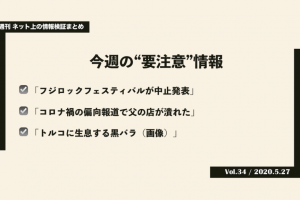

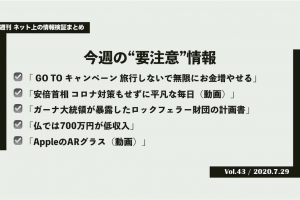

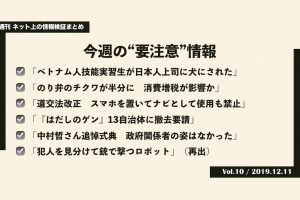

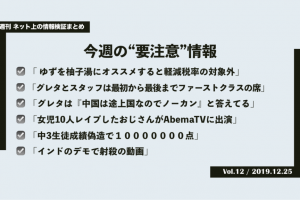

ツイッターだけではなく、すべてのソーシャルメディア・プラットフォームはコンテンツ・モデレーションに日々取り組んでいます。しかし、多くのユーザーに納得してもらう形でそれを実施するのは、とても難しいとも言えます。

コンテンツ・モデレーションとは、少し乱暴にまとめると、ソーシャルメディア上で飛び交う情報が、ユーザーに「役に立つ」と思ってもらえたり、実際にメッセージのやりとりを、少しでも気持ちよく、楽しくしてもらうために、特定の情報を目立たせたり、あるいは、見えにくくするという作業です。

見えやすいところでは、ツイッターが多くの人たちが使っているハッシュタグを「What’s Happening?」として表示したり、インスタグラムで時に「刺激的な(graphic)コンテンツですが、表示しますか?」というメッセージが現れたりするような対応です。

その中で、ディスインフォメーションと戦っている人たちにとって最大の関心事は、急速に拡散していたり、長期間にわたり公開され続けていると、暴力を誘発したり、特定の個人が不要な攻撃(ネット上だけでなく、物理的にも)を受ける可能性があるメッセージを、どのように制御しているのか、ということです。

完全に透明にできない「ジレンマ」

例えば、ツイッターはTwitterルール、フェースブックはFacebookコミュニティ規定、ユーチューブはコミュニティ・ガイドラインとして、大枠の原則を明らかにしています。

「暴力的な発言」「ヘイトスピーチ」「他人になりすましての発信」「自殺を誘発するもの」「性的なコンテンツ」などの項目が列挙されています。しかし、重要なのは、プラットフォーム側が、漠然としか示されていない原則を、それぞれのポストに対し「どのように適用し、判断を下しているか」という運用のしかたです。

しかし、それを完全に明らかにすることは、2つの理由から難しいものです。

まず、もし「どのようなメッセージを規制したり、最悪の場合、削除したりするのか」という運用ルールが明らかになってしまえば、ウソや人を攻撃するメッセージを拡散しようとする悪意を持った人は、そのルールの裏をかこうとするでしょう。そうすると、プラットフォーム側が安全のための防衛ができなくなってしまいます。

もうひとつは、商業的な問題です。プラットフォーム企業はなるべくたくさんの人に利用してもらうことで、広告収入などを得て収益を上げています。ルールが厳しく、すぐに制限がかかってしまう場だと、人が寄りつかなくなってしまうでしょう。ソーシャルメディアには「何が出てくるのかわからない、わくわく感」のようなものも大事な要素だからです。

コンテンツ・モデレーションという、目立たない領域に、どれだけコストや人員を割くかという、経営上の問題もあります。

「表現の自由」という大原則もあります。ユーザーと訴訟などのトラブルを抱えるタネも増やすことになり、悩ましいものです。

そうすると、一般論としては、著しく有害と思われるコンテンツがポストされていても、プラットフォーム側は、そのまま放置したり、ポストした本人への警告や削除、アカウント停止などに消極的になってしまうという力学が働くことになります。

ファクトチェッカーたちの「危機感」

ファクトチェッカーのコミュニティは、そのルールの不透明性を長年にわたり問題視してきました。

ディスインフォメーションは命にもかかわるような最悪の事態を招く危険性があるからです。ソーシャルメディアで間違った情報が拡散し、犯罪者扱いされてリンチに遭い殺されてしまったりした例も珍しくありません。

民主主義の根幹を揺るがせた、2020年のアメリカ大統領選挙の結果をめぐって、トランプ支持者が連邦議会議事堂に乱入したような暴動も起きています。日本でもソーシャルメディアでの心ないコメントの攻撃で自殺に追い込まれた人もいました。

ファクトチェッカーたちが深刻な事態を招く恐れがあるディスインフォメーションだと認識し、プラットフォーム側に警告を出したり、削除したりするような措置を求めても、なかなか対応してくれなかったり、運用ルールについて説明を求めても満足な回答が得られないという問題は、ここ数年の大きな課題でした。

例えば、IFCNでは、2022年1月に「世界規模でディスインフォメーション拡散の温床になっている」として、ユーチューブに公開質問状を出し(英語ですが翻訳アプリなどで読んでみてください)、モデレーションの原則をAIの使用の実態なども含めて明らかにすべきで、対応も「削除するか、しないか」ではなく、「間違いであること」を表示するような対応をすべきなどの要求をしました。

GF10では、メタ(フェースブックとインスタグラム、南米やインドなどで最もユーザー数が多いWhatsAppなどを運営)が主催してモデレーションのポリシーなどを説明するセッションもありましたが、企業の規模が大きく、世界各地での運用はローカルスタッフに任せているため、担当者が個別の問題に明確に反応できない場面もあり、不信感が募っている状況も浮き彫りになっていました。

奥村 信幸(Okumura, Nobuyuki)

武蔵大学社会学部教授、FIJ理事

1964年生まれ。上智大学大学院修了(国際関係学修士)。1989年よりテレビ朝日で『ニュースステーション』ディレクター等を務める。米ジョンズホプキンス大学国際関係高等大学院ライシャワーセンター客員研究員、立命館大学教授を経て、2014年より現職。訳書に『インテリジェンス・ジャーナリズムー確かなニュースを見極めるための考え方と実践』(ビル・コヴァッチ著、トム・ローゼンスティール著、ミネルヴァ書房)。