2019年8月27日、First Draftのツイッターアカウントが、AIによるフェイクニュース検知に関するレポートについてツイートしたので、さっそく拝読した。

・Are We Safe Yet? The Limitations of Distributional Features for Fake News Detection(2019年8月26日、Tal Schuster, Roei Schuster, Darsh J Shah, Regina Barzilay)

このレポートでは、フェイクニュースの発信元による判別には根本的な問題があり、真実性の検証の方がアプローチとして有効であるとしている。真実性の検証には事実の検証と自動生成された文章であるかどうかの確認があるという。結論としてはまだまだ課題があるとなっていた。

私はAIによる検知には「真実」の基準がないと機能しないと考えているので、「真実」の問題を素通りして方法論が先走っていることに違和感を禁じ得ない。機械学習するにしても、どれが正しいかわかっているデータが必要と思うのだが、それが難しい。

AIによる真実性の検証の際、大手メディアでの報道内容や文章の書き方などを元にすることがあるが、大手メディアの記事が正しいとは限らない。たとえばニューヨークタイムズは同紙記者が書いた盗用や捏造した記事30本以上を掲載していた(2003年ジェイソン・ブレア事件)。ロシアがSNSに投稿したプロパガンダを世界の3,000のメディアが紹介していたことも明らかになっている。そのため大手メディアの記事を元に判断しても誤謬は避けられない。

・Russian Trolls Duped Global Media And Nearly 40 Celebrities(2017年11月4日、NBC NEWS)

ファクトチェックが終わったもののみを対象にすればよいのかもしれないが、時間が経過してから誤りであったことがわかることも少なくない。松本サリン事件のような冤罪事件もあれば、因果関係がすぐには解明できない公害病もある。充分な時間があれば科学理論そのものが変わって科学的根拠が覆されることも起こる。また現在の日本のように公文書が廃棄、改竄されるような状況では過去の事象についての検証は不可能となる。

それでも我々は日々生きてゆくために情報を摂取し、なにを信じ、なにを疑うか、なにを信じないかを決めてゆかなければならない。そこにおいてファクトチェックの果たす役割は大きい。

本稿ではファクトチェックが現在直面している問題の概要とその前提に潜む「真実の裁定者」について整理してみたい。

なお、ここでは「フェイクニュース」をネット世論操作(disinformation campaign、computational propaganda)として広義にとらえており、ファクトチェック・イニシアティブ(FIJ)の対象としているフェイクニュースよりも広くなっている。そうした理由は、狭義のフェイクニュースで社会的影響が問題となるものの多くはネット世論操作の一部であることが多く、その定義や対策において一緒に扱われることと、その境界線を厳密に引くことが難しいためである。

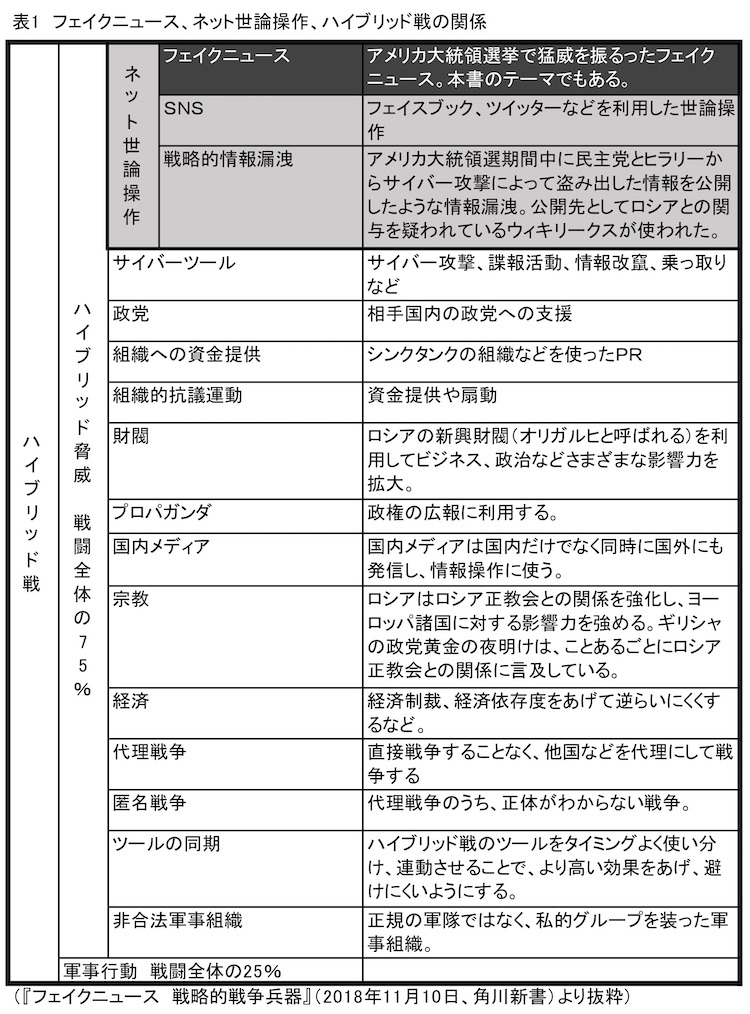

参考のためロシアにおけるフェイクニュースの位置づけを示した表をご紹介する。

フェイクニュースの圧倒的優位性

ファクトチェックしてフェイクニュースを暴くのはまっとうで効果的な対策のように思えるが、そこには根本的な問題がある。

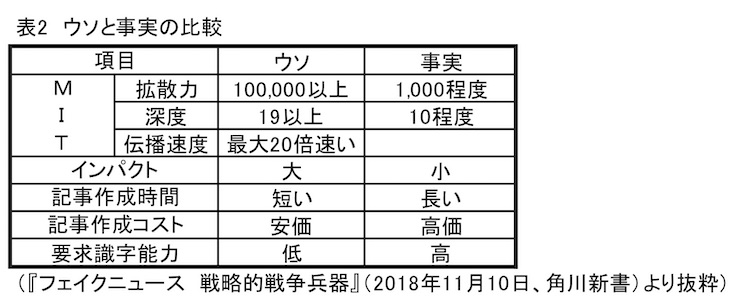

これは拙著『フェイクニュース 戦略的戦争兵器』(角川新書)に掲載した表である。これを見るとよくわかるように、拡散力、速度、インパクト、コストあらゆる面でウソつまりフェイクニュースの方が事実=検証結果の情報よりも強力である。特に問題となるのが速度で、選挙のように時間が制限されていると検証の結果の拡散が投票に間に合わないことが起こり得る。

この圧倒的な差を埋める方法として期待されているのがAIを利用した自動検知である。しかしそれも前述のようにかなり制限がある。

(1) フェイクニュースの定義は多様

フェイクニュースとは事実ではない情報のことを指す言葉であるが、その定義は多様である。突っ込んだ話を進める前に整理しておきたい。ありていに言うと、フェイクニュースの定義は決め手となるものがない。きちんと定義できれば自動検知もできるはずなので、当然の話とも言える。

なお、FIJでは、情報の「事実言明」を検証することになっており、その判定は9つのレーティングに分類している(レーティングがない場合もある。FIJのファクトチェックの定義については、ガイドラインを参照ください)。

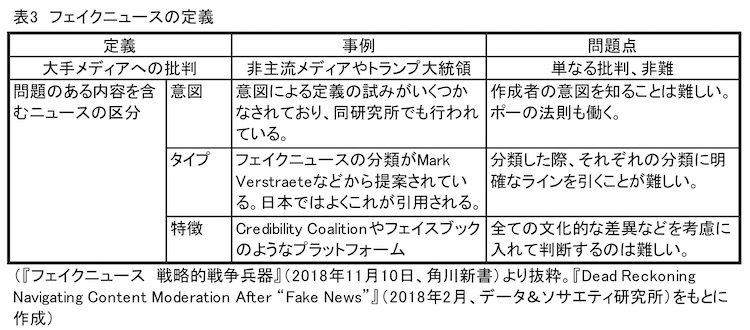

表3にデータ&ソサエティ研究所のレポートを参考に現在提示されているフェイクニュースの定義と問題点を整理した。

実はフェイクニュースという言葉は立場の異なる相手を攻撃する際に用いられる。トランプ大統領がよい例である。気にくわないメディアをフェイクニュースと名指しで攻撃している。大手メディアに対して批判的な非主流メディアや個人がフェイクニュースと批判するのもこれに当たる。主として大手メディアへの批判の際に用いる言葉になっている。為政者がこういう使い方をする時の影響は大きいし、フェイクニュース対策法という名の下に自分に批判的なメディアを潰す際にも用いられる。

もうひとつは問題のある内容を含むニュースである。こちらの方が我々が一般にイメージするものに近い。問題のとらえ方によって3つに分類できる。

● 配信者の意図による定義

配信者がどのような意図を持って書いたかによってフェイクニュースに該当するかどうかを判断する方法が最初の定義方法だ。だましたり、被害を与えるような意図で作られていたらフェイクニュースというわけだ。

しかし、これは「ポーの法則」が当てはまる。「ポーの法則」とはネイサン・ポーが言い出した法則で、明確にユーモアだと断っていない限り、過激な主張とネタの区別はつけられないというものである。パロディのニュースが広まった結果、本当のニュースと誤認する人がたくさん現れることもある。彼らは作成者の意図を正しく理解できなかったことになるが、この種の誤解は避けられないというのがポーの法則だ。

● フェイクニュースのタイプで分類し定義

フェイクニュースのタイプで区分し定義する方法である。ここでは代表的な2つを紹介する。

【Mark Verstraeteの5類型】

①噂(hoaxes)

②プロパガンダ(propaganda)

③トロール(trolling)

④風刺(satire)

⑤ユーモア(humor)

(Mark Verstraete、Drek E.Bambauer、Jane Bambauer “Identifying and Countering Fake News”2017)

【クレア・ワードルの7類型】

①風刺、パロディ(satire、parody)…悪意はないが、信じる人がいる可能性はある

②間違った関連付け(false connection)…内容と関係のない見出し、画像、キャプションがついている

③ミスリーディング(misleading content)…テーマや個人についてミスリーディングするような情報の使い方をしている

④間違い(false content)…正しい内容と間違った内容が混在している

⑤なりすまし(imposter content)…情報源をなりすます

⑥操作的(manipulated content)…正しい情報や画像をだます目的で操作する

⑦ねつ造(fabricated content)…100%ウソの内容を作り出し、だましたり被害を与える

(『フェイクニュースは複雑(Fake news. It’s complicated.)』2017年2月16日、First Draft)

この7類型は、後の方ほどウソの度合いがひどくなる。意図を基準にしているが、作成者の手を離れて流布しているニュースからその意図を正確に推し量ることは難しいという基本的な問題がある。ニュースを受け取った者には制作者の意図はわからないし、そもそも考えないことの方が多いだろう。

● 特徴による定義

特徴による定義では、文字数、使用する言葉の頻度、句読点の使い方、外部リンク先、ビジュアルなどのフェイクニュース共通の特徴を抽出する。AIの応用も試みられている。実際に行うためには資金と時間と人手があるグーグル、フェイスブックなどに限定される可能性が高い。

前述のようにAIによるチェックには限界がある上、チェックを行う者がアルゴリズム責任を負えるのかという問題も生じる。

(2) 現在行われているフェイクニュース対策

定義が固定していない状況でどのように対策するのかはなはだ難しいのだが、現実にフェイクニュースによる問題が発生している以上、対処しなければならない。

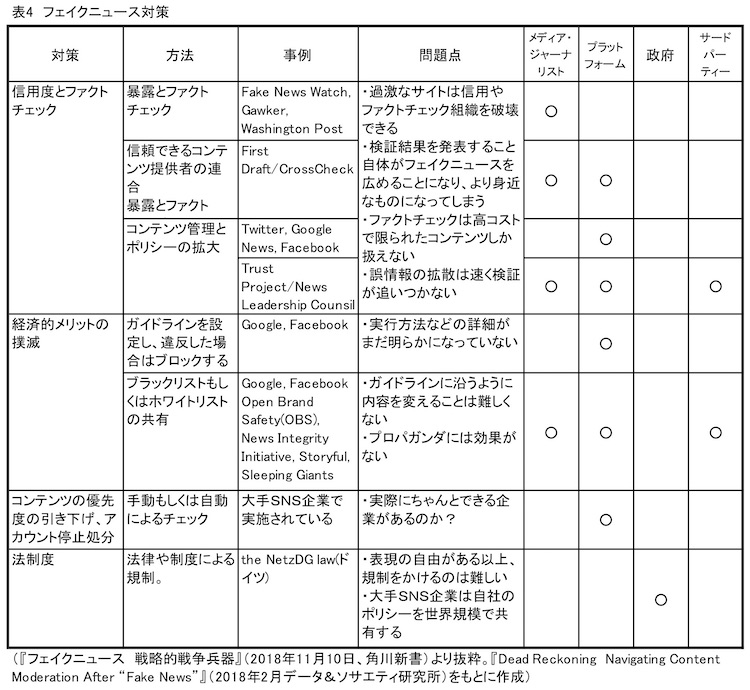

現在行われている対策は、「信用度とファクトチェックによる対策」、「経済的メリットの撲滅」「コンテンツの優先度の引き下げとアカウント停止処分」、「法制度」の4つに分類できる。残念ながらいずれの対策も充分な効果を上げているとは言いがたい状況である。

最近(2019年8月22日)公開された『OxTEC: A report on anti-disinformation initiatives』は、世界各国のネット世論操作対策の状況を概括する資料である。世界的にネット世論操作の脅威への警戒が強まっており、さまざまな方法が試みられているが、効果は限定的であると結論で述べている。

・『OxTEC: A report on anti-disinformation initiatives』(BBC Monitoring’s specialist Disinformation Team、Oxford Technology and Elections Commission (OxTEC))

「真実の裁定者」の不在

ファクトチェックだけではなく、現在行われているほとんどの対策がフェイクニュースに効果的に対処できていない。対策や提言に言及しているレポートの多くは、官民学およびメディアが連携していなかなければならないという結論が多く、フェイクニュースを含めたネット世論操作あるいはさらに範囲を広げてハイブリッド戦という安全保障の枠組みで問題をとらえている。目先の現象であるフェイクニュースだけに対応していても問題は解決できないという認識を持っているのだろう。

フェイクニュースとは民主主義の脆弱性を突いた攻撃だから、民主主義の枠内で有効に排除する仕組みを作ることが困難となっている。民主主義的世界観においては、最終的な「真実の裁定者」は国民である。国民の合意や承認により、それが制度や法律になることもある。FIJのミッションのページに「真実の最終裁定は言論社会に生きる人々に委ねられています。私たちが志向するのは、人々が正確な事実認識を共有できるよう、判断材料を提供することです。」と書いてある通りだ。

しかし、フェイクニュースは「真実の裁定者」たる国民を蝕み、正しい判断を行えないように試みる攻撃である。「真実の裁定者」が公正な裁定を行えない状況に陥っている状況が現在なのである。

さきほどのFIJのページには「こうした真偽を検証する活動の量的・質的な向上が、誤った情報に対する人々や社会の免疫力を高め、ひいては言論の自由を守り、民主主義を強くすることにつながると信じます。」と書いてある。

ただ、これまで見てきたように多くの課題と限界があり、国民が「真実の裁定者」として充分に機能できていない(別稿でメディア・リテラシーについて述べる予定である)。また、「真実の裁定者」である国民の意思を迅速に反映させる具体的な方法も課題となる。その方法があるなら、現在すでに対策としておこなわれているはずだが、残念ながら今のところない。

加えて言うと、現代では「民主主義は選挙で殺される」ようになっている。選挙によって選ばれた政治家が非民主主義への道を進むのである。『民主主義の死に方ー二極化する政治が招く独裁への道ー』(スティーブン・レビツキー、ダニエル・ジラット)において指摘されているほか、国民の投票行動が非合理的におこなわれているかについてジェイソン・ブレナン、ブライアン・カプランなどなどが指摘している。民主主義における「真実の裁定者」である国民の判断に疑問が持たれている。これは民主主義に最初から内在する問題であり、これまでは民主主義の枠外の仕組み(スティーブン・レビツキー、ダニエル・ジラット流に言うなら“柔らかいガードレール”)で保全されてきた。SNSの普及になどによってそれが破綻した。

ここでは詳細には触れないが、下記に紹介記事があるので興味ある方はご覧いただければ幸いである。

・死に瀕する民主主義 一人ひとりが民主主義を守る自覚を ~『民主主義の死に方―二極化する政治が招く独裁への道―』書評(一田和樹、2018年12月8日、Harbor Business Online)

フェイクニュースを始めとするネット世論操作が選挙を破壊している状況では、国民に「真実の裁定者」であることを求めるのは無理があるかもしれない。そうすべきとしてもなんの用意もなく始められることではない。

一田 和樹(Ichita, Kazuki)

小説家

コンサルタント会社を経ていくつかのIT企業の役員を歴任、その後、小説家としてデビュー。ダークファンタジーなど幅広い分野を手がける。著作に『フェイクニュース 戦略的戦争兵器』(角川新書)、『犯罪「事前」捜査』(角川新書)。近著『大正地獄浪漫』(星海社)、『天才ハッカー安部響子と2,048人の犯罪者たち』(集英社)。代表作『原発サイバートラップ』(原書房、集英社)、『天才ハッカー安部響子と五分間の相棒』(集英社)。